備受Meta審核規定“折磨”,依舊猛發論文!

表示可能要辭職的LeCun帶著最新研究來了,仍然和三位FAIR同事合作。

Yann LeCun團隊新論文發現了自監督模型JEPAs(聯合嵌入預測架構)的隱藏技能——

學會了數據的“密度”

這里的“數據密度”可以理解成數據的常見程度:密度高的樣本是更典型、更常見的數據,密度低的是少見的、甚至異常的數據。

JEPAs原本被視為僅擅長特征提取的模型,這次LeCun團隊發現該模型在訓練過程中悄悄掌握了感知數據常見程度的能力。

這就意味著,只要JEPAs訓練成功了,不用額外做什么,就能用它來判斷一個樣本的常見程度

打破了學界長期以來“JEPAs僅學特征、與數據密度無關”的認知。

核心發現:反坍縮能精準學習數據密度

要理解這一新發現的突破,首先來說一下JEPAs。

△源自《A Path Towards Autonomous Machine Intelligence》圖12

JEPAs作為LeCun團隊近年重點推進的自監督學習框架,核心優勢在于無需人工標注,模型就能自主從海量數據中學習特征規律,學完后就可以直接適配圖像識別、跨模態匹配等下游任務,是AI領域高效學習的代表性模型。

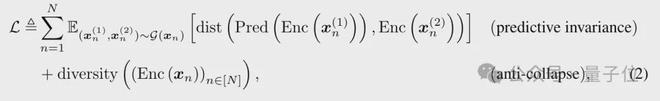

此前學界普遍認為,JEPAs的訓練只有兩個核心目標:

- 一是latent空間預測。即給原始數據(如圖像)做輕微擾動(裁剪、調色)后,擾動數據的特征表示(模型內部理解的數據形態)能從原始數據特征中精準預測;

- 二是反坍縮。防止所有樣本的特征趨同一致。

而論文的新發現就是從反坍縮中得來。

如果所有數據的特征都一樣,模型相當于白學,所以過去大家都將反坍縮單純視為避免特征失效的保障手段,沒有意識到它還有更深層的作用。

LeCun團隊就聚焦于反坍縮的的隱藏價值,研究通過變量替換公式高維統計特性推導證明,反坍縮不僅能防止特征坍縮,更能讓JEPAs精準學習數據密度

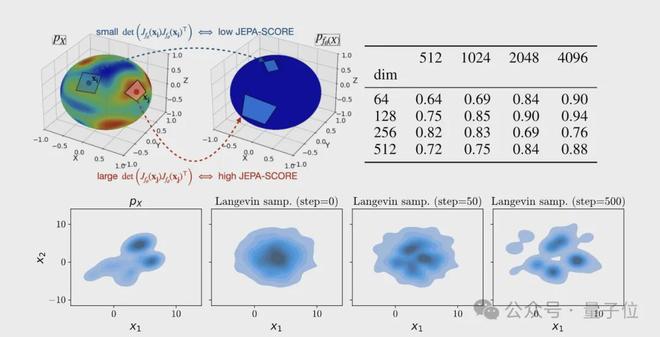

從理論層面看,當JEPAs輸出高斯嵌入(高維空間中近似均勻分布于超球面的特征)時,模型必須通過雅可比矩陣(反映模型對樣本微小變化的響應程度)感知數據密度,才能滿足訓練時的約束條件,這意味著學習數據密度并不是偶然,而是JEPAs訓練過程中的必然結果

為了讓這種隱藏的密度感知能力落地實用,團隊還提出了關鍵工具JEPA-SCORE

這是從JEPAs 中提取數據密度的量化指標,核心作用就是給樣本的常見度打分